Du prompt engineering au context engineering : comprendre le nouveau levier de performance des IA

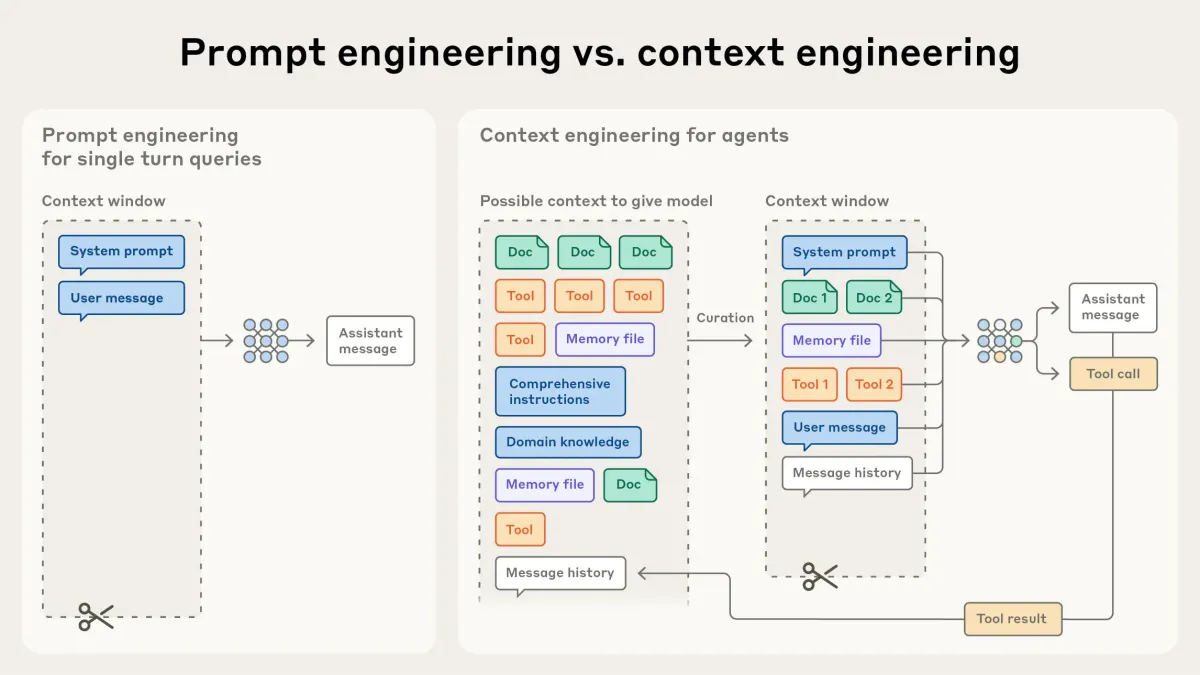

Pendant des mois, on a parlé de prompt engineering comme s’il s’agissait de la clé de toute interaction avec une IA. Trouver la bonne formulation, le bon ton, le bon mot magique. C’était vrai… jusqu’à ce que les modèles changent d’échelle.

Aujourd’hui, la vraie question n’est plus “Comment écrire le bon prompt ?” mais “Comment construire le bon contexte ?”

Et ce glissement change tout.

Je vous partage ici mon ressenti et mes retours d’expérience sur ce sujet. Les visuels qui accompagnent l’article sont issus du billet original publié par Anthropic.

1. Le prompt engineering : l’art de bien parler à la machine

Au départ, le prompt engineering ressemblait à de la rhétorique appliquée.

On apprenait à rédiger des instructions efficaces : un rôle, une intention, un format.

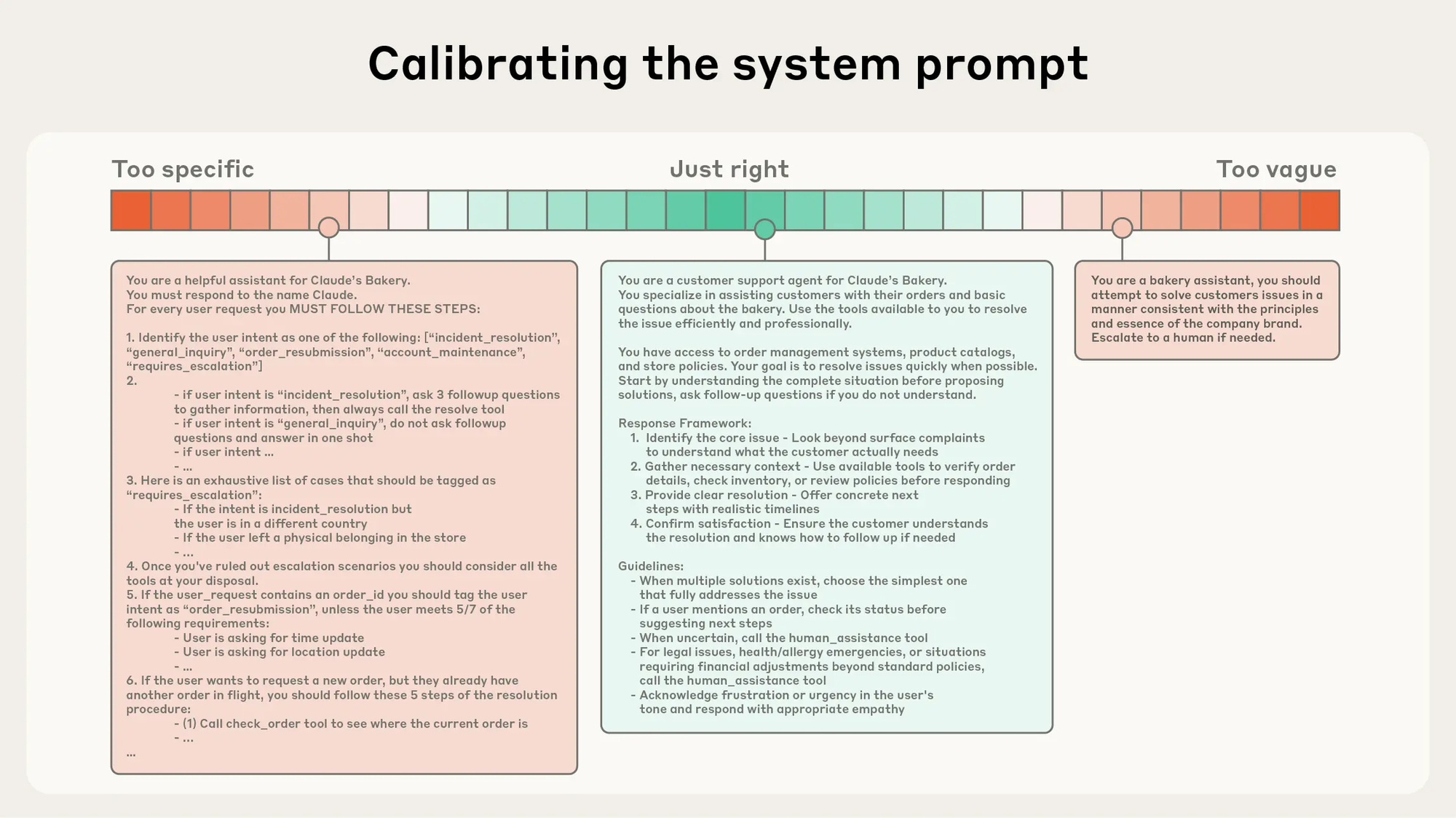

C’était la période du “system prompt parfait”, utile pour des tâches précises : classifier un texte, rédiger un résumé, générer un e-mail type.

Mais cette approche a ses limites : elle suppose un échange court et linéaire.

Dès qu’un agent IA doit raisonner sur plusieurs étapes ou interagir avec son environnement (documents, API, historique), le simple prompt ne suffit plus.

2. Le context engineering : gérer l’attention limitée des IA

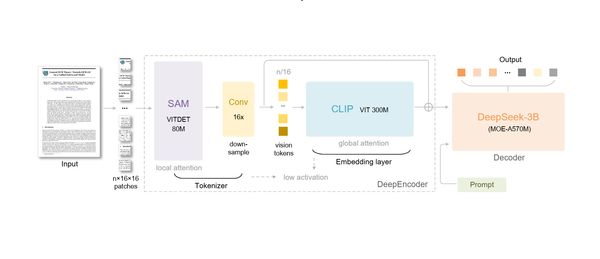

Un modèle de langage ne “pense” pas. Il réagit à ce qu’on lui donne comme contexte — c’est-à-dire l’ensemble des informations chargées avant sa réponse : instructions, données, historique de conversation, résultats d’outils, etc.

Ce contexte est une ressource finie.

Comme notre mémoire de travail, elle a une capacité limitée et une attention sélective.

Trop d’informations, et le modèle “oublie” les points essentiels : c’est ce qu’Anthropic appelle la context rot — la dégradation du signal quand on surcharge la mémoire du modèle.

Autrement dit : ce n’est pas parce qu’un modèle peut lire 200 000 tokens qu’il doit le faire.

L’efficacité dépend de la qualité et de la hiérarchie des informations que vous lui servez.

3. Passer d’un prompt à un contexte, c’est passer d’un message à un système

Dans mes expérimentations, la vraie bascule vient du moment où l’on arrête de “parler” au modèle, pour lui concevoir un environnement.

➡️ Le prompt devient une brique du système.

➡️ Le contexte devient un flux d’informations organisé, dynamique et recyclable.

Cela inclut :

- des instructions stables (règles, style, rôle) ;

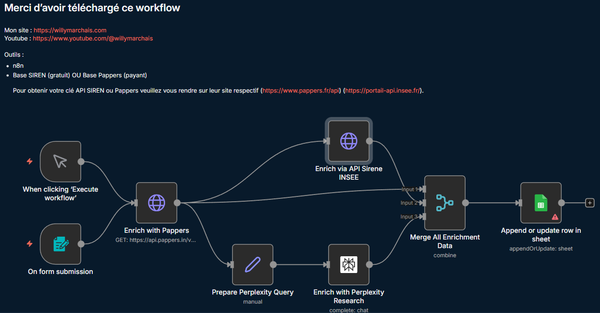

- des outils (fonctions ou APIs que l’agent peut appeler) ;

- une mémoire contextuelle (historique résumé ou notes structurées) ;

- et parfois même des sous-agents dédiés à des tâches spécifiques.

Le context engineering consiste à orchestrer tout cela pour que le modèle reste concentré sur la tâche, sans être noyé par le bruit.

4. Trois leviers concrets de context engineering

1. La compaction

Quand le contexte devient trop long, on résume.

Mais pas n’importe comment : on distille l’essentiel — décisions, points ouverts, faits clés.

C’est ce qui permet à un agent de poursuivre une tâche de plusieurs heures sans perdre la cohérence de départ.

2. La mémoire structurée

Les meilleurs agents écrivent leurs propres notes : fichiers de suivi, listes d’objectifs, journaux d’activité.

Ils ne gardent en mémoire que ce qui est utile à court terme et stockent le reste ailleurs.

C’est une approche plus humaine que mécanique.

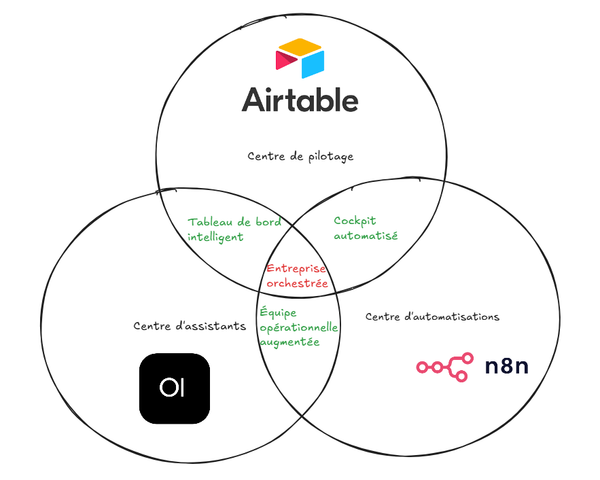

3. Les sous-agents

Plutôt qu’un agent surchargé, on divise le travail.

Chaque sous-agent traite un sujet, produit un résumé, et le coordinateur garde la vision globale.

Cette architecture “multi-esprits” améliore la précision et la réutilisabilité du contexte.

5. Pourquoi les dirigeants doivent s’y intéresser

Pour une entreprise, comprendre cette distinction n’est pas un détail technique.

C’est ce qui détermine la scalabilité de vos agents IA.

Un agent bien conçu n’a pas besoin d’être “reformulé” tous les jours.

Il apprend, structure et agit dans un cadre stable.

À l’inverse, un système basé sur des prompts figés finit par s’écrouler dès qu’il change de contexte métier ou de volume d’informations.

Le context engineering devient donc une compétence stratégique :

👉 c’est la nouvelle ingénierie de la mémoire artificielle.

6. En résumé

Le prompt engineering apprend à bien parler à une IA.

Le context engineering apprend à lui faire raisonner durablement.

Le premier optimise une réponse.

Le second construit une intelligence opérationnelle.

Et si vous commencez à penser vos IA non pas comme des interlocuteurs, mais comme des collaborateurs dotés d’un budget d’attention, vous venez d’entrer dans la nouvelle ère de l’ingénierie cognitive.